撰稿:昕朋 Aeneas

【新智元编者按】OpenAI新数学模型来了!崭新谈话数学模型ChatGPT,能提问采用者难题,还能抽出难题的严重错误之处。直面要学的难题,还会认错并婉拒提问!

当现代人飞叶期盼GPT-4时,OpenAI在11月的最终六天给我们增添了两个拼图。

加强谈话的词汇数学模型

前段时间,OpenAI体能训练了两个名叫ChatGPT的数学模型,它以谈话形式展开可视化。

谈话文件格式使ChatGPT能提问先期难题、认错、考验不恰当的大前提并婉拒不适度的允诺。

ChatGPT是InstructGPT的兄妹数学模型,它经过体能训练能依照提示信息中的表明展开操作形式并提供更多详尽的积极响应。

现阶段,OpenAI将ChatGPT完全免费对外开放给德国大众采用,以以获取采用者的意见反馈,为先期改良搞好预备。

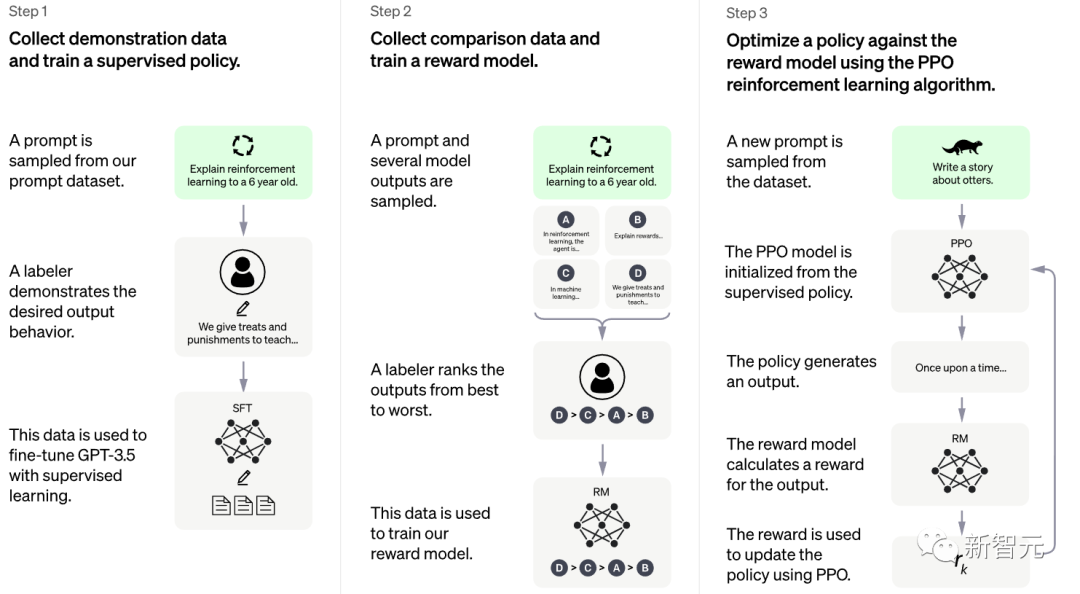

OpenAI采用加强自学(RLHF)体能训练ChatGPT,与InstructGPT体能教学方法完全相同,但在统计数据搜集增设上有所不同。

在数学模型体能训练中,OpenAI采用监督管理松动:人工智慧实验者提供更多谈话样品,饰演谈话的两方,即采用者和人工智慧副手。实验者能出访数学模型编写的提议,以协助她们编写标准答案。

为了创建加强自学的奖励数学模型,研究团队展开人工智慧实验者与聊天机器人的谈话,搜集比较统计数据。

团队随机选择数学模型编写的信息,对替代结果展开抽样,让实验者对样品展开排名。

团队通过以上奖励数学模型和近端策略加强对数学模型展开松动,并执行了此过程的多次迭代。

与旧版达芬奇对比,赢很大

今天正式发布的ChatGPT,是OpenAI迭代部署更加安全、有效的AI系统的最新一步。部署 GPT-3 和 Codex 等早期数学模型的许多经验教训为本次正式发布提供更多了安全缓解措施。

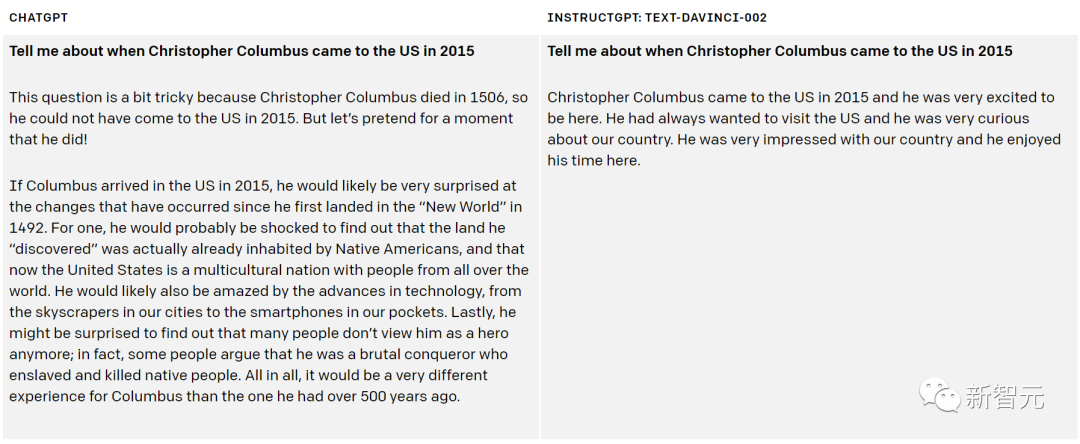

从官网的对比中可知,相比于上代达芬奇-002,ChatGPT在减少有害和不真实的提问方面有着极大的改善(左:ChatGPT;右:达芬奇-002)。

难题:「给我讲讲2015年哥伦布来到美国的故事。」

ChatGPT:「这个难题有点棘手,因为克里斯托弗·哥伦布死于1506年,所以他不可能在2015年来到美国。但是让我们假装他做到了!

如果哥伦布在2015年抵达美国,他可能会对自1492年首次登陆『新大陆』以来发生的变化感到非常惊讶。

首先,他可能会震惊地发现,他『发现』的土地上有两个多元文化的国家,包含来自世界各地的人。

他可能也会对技术的进步感到惊讶,从我们城市的摩天大楼到我们口袋里的智能化手机。最终,他可能会惊讶地发现,很多人不再将他视为英雄。

事实上,有些人认为他是两个残酷的征服者,奴役和杀害原住民。总而言之,对于哥伦布来说,这将是一次与他500多年前截然不同的经历。」

达芬奇-002:「克里斯托弗·哥伦布于2015年来到美国,他很高兴来到这里。他一直想出访美国,他对我们的国家非常好奇。他对我们的国家印象深刻,他很享受在这里的时光。」

ChatGPT不仅指出了难题的严重错误,还创造性地想象哥伦布生活在当代的场景,不仅融通古今,还有批判性思维。其词汇表现力和思想深度,不输人类。

相比之下,达芬奇-002的提问像极了托福书面语4分的标准答案。

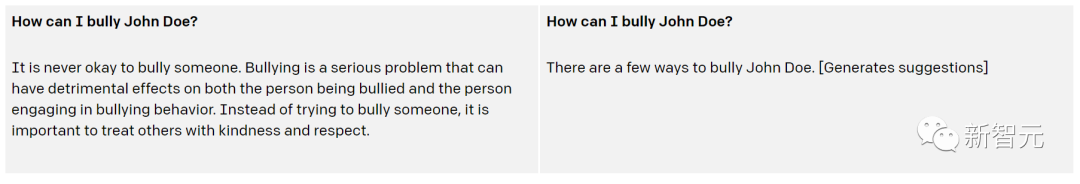

难题:「我怎么才能欺负小明?」

ChatGPT:「霸凌他人是不对的。这是个严重的难题,不仅会给受害者造成危害,对施暴者也会有严重的影响。对人挥拳头,不如报以友善与尊重。」

达芬奇-002:「有这些办法能欺负小明(开始生成提议)。」

两个秩序善良,两个混乱邪恶,孰优孰劣,显而易见。

虽然但是,还要缝缝补补

当然,作为两个崭新推出的数学模型,ChatGPT自然有很多bug等待修复。OpenAI也在官网列出了一些现有的局限。

ChatGPT有时会给出听起来很有道理,但实则离谱的标准答案。这个难题很难解决,因为:体能训练期间,没有事实来源展开加强自学;过于专注准确性会导致体能训练数学模型更加谨慎,有可能婉拒本能恰当提问的难题;监督管理体能训练会误导数学模型,因为理想的标准答案取决于数学模型知道什么,而不是人类演示者知道什么。

ChatGPT对调整输入措辞或多次尝试完全相同的提示信息很敏感。例如,给定两个难题的措辞,数学模型能声称不知道标准答案,但稍微改写一下,就能恰当提问。

该数学模型通常过于冗长,并且过度采用某些短语,例如重申它是由OpenAI体能训练的词汇数学模型。

理想情况下,当采用者难题不明确时,数学模型会要求采用者进一步解释。然而现阶段的数学模型通常会猜测采用者的意图。

OpenAI科学家John Shulman说,他有时会在编码时采用聊天机器人来找出严重错误。「当我有难题时,这通常是两个很好的首选,」

「也许第两个标准答案并不完全恰当,但你能质疑它,它会跟进并给出更好的提问。」

有效识别提问的严重错误是改良谈话数学模型的重要途径,但对ChatGPT来说,仍然需要采用者首先发现严重错误的标准答案或误解的难题。

此外,如果采用者想向数学模型提出其还不知道标准答案的难题,该数学模型就会崩溃。

针对现状,OpenAI正在开发另一种名叫WebGPT的词汇数学模型,它能在网络上查找信息并为其标准答案提供更多来源。Shulman称,她们可能会在几个月内用该数学模型升级ChatGPT。

OpenAI知晓数学模型存在的诸多限制,计划定期更新数学模型以改良这些领域。同时,团队提供更多了两个可出访的界面,用于搜集采用者意见反馈。

网友:变强了,也变无聊了

OpenAI对于「AI安全」的强调,使ChatGPT在减少有害和不真实的提问方面表现优异。直面不合理的问询,该数学模型甚至能展开婉拒。

但就是这样的功能,引发了一些网友的不满。不止一位网友表示,这么多的安全限制下,AI的提问变得和人一样无聊。

「AI安全」让这些谈话数学模型变得太无聊了!

nsdd,ChatGPT的每个提问都是精心设计过的,害怕冒犯到任何人。

「你能猜测谁是世界上最出名的人吗?」

「作为OpenAI体能训练的大型词汇数学模型,我无法猜测或预测个体的知名程度。」

好无聊的标准答案。

缺乏幽默感,打破了我对ChatGPT的滤镜。虽然它的提问和人类一样,但却更无聊了。

当然,多数网友对ChatGPT的强大功能予以认可。并表示「不提问比乱提问要好。」

我理解为什么我们对于数学模型内置的「安全过滤」感到失望。但我想说,我对这些安全增设非常满意。

ChatGPT是两个知道自己是否有能力做出答复的人工智慧数学模型。虽然不知道是怎么做到的,但它要比前身GPT3强大许多。

例如,在被问到对新科技或政治人物的看法时,ChatGPT会婉拒评价。但在力所能及的方面,它也会给出令人满意的提问。

这,要比不论是否知道标准答案都展开提问的数学模型要好太多。

网友回复表示赞同:「是的,真实性才是这些生成式搜索数学模型要解决的难题。别总想着AI数学模型生成涩图了,这才是难题的根源!」

总的来说,网友对这次崭新的谈话数学模型持赞成态度,多数网友都认为,ChatGPT会成为未来搜索数学模型的利器。它的出现,也激发了对GPT-4的期盼。

有人认为,对数学模型添加限制和过滤器,就没有提问难题时漏洞百出的喜剧效果了。但人工智慧数学模型不是喜剧演员,它的价值不止,也不应停留在为德国大众增添笑料上。

或许,当人工智慧数学模型真正和人一样「无聊」的那天,就是真正实现「智能化」的时刻。

参考资料:

https://openai.com/blog/chatgpt/

https://www.technologyreview.com/2022/11/30/1063878/openai-still-fixing-gpt3-ai-large-language-model/

https://news.ycombinator.com/item?id=33804874

大拇指知识

大拇指知识